Google apuesta por la interactividad como nuevo paradigma de la inteligencia artificial, permitiendo a los usuarios manipular objetos tridimensionales y experimentar con variables en tiempo real.

En un movimiento que redefine los límites de la asistencia digital, Google ha anunciado una actualización sustancial de su inteligencia artificial Gemini. A partir de ahora, el asistente no solo será capaz de ofrecer respuestas textuales o imágenes estáticas, sino que podrá generar simulaciones funcionales y modelos 3D completamente interactivos. Esta funcionalidad, que ya comienza a desplegarse globalmente, transforma la manera en que estudiantes, profesionales e investigadores se relacionan con conceptos abstractos y datos complejos.

La compañía californiana ha decidido ir más allá de la generación de contenido pasivo. Mientras otros asistentes de IA se centran en producir texto, imágenes o vídeos, Google apuesta por el «visual computing»: herramientas que permiten al usuario no solo ver, sino también experimentar, manipular y modificar parámetros en tiempo real. Con esta actualización, Gemini se convierte en una suerte de laboratorio virtual portátil accesible desde cualquier navegador o dispositivo móvil.

Interactividad: la clave de la nueva era para Gemini

Tradicionalmente, los asistentes de inteligencia artificial explicaban fenómenos complejos mediante párrafos densos o ilustraciones fijas. El usuario podía leer sobre la órbita de la Luna, pero no podía modificar su velocidad, detener su trayectoria ni observarla desde otro ángulo. Esa limitación ha quedado atrás.

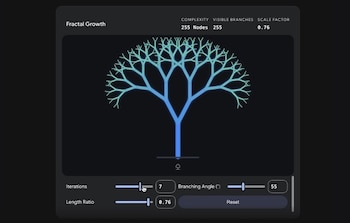

Con la última versión de Gemini, al realizar una consulta como «simula el movimiento de un péndulo doble» o «muéstrame el efecto Doppler», el asistente genera un modelo tridimensional completamente funcional. El usuario puede rotar la vista, acercar o alejar la imagen, pausar la animación y —lo más relevante— ajustar variables mediante controles deslizantes o campos numéricos. Por ejemplo, en una simulación de la órbita lunar, es posible modificar la velocidad del satélite, ocultar las trayectorias de referencia o cambiar la masa de los cuerpos celestes, observando al instante cómo se altera el comportamiento del sistema.

Esta capacidad de «experimentar» sin necesidad de software especializado ni conocimientos de programación abre un abanico de posibilidades hasta ahora reservado a entornos educativos o de ingeniería de alto costo.

Aplicaciones para estudiantes, creadores y profesionales

El impacto de esta actualización es transversal. En el ámbito educativo, docentes y alumnos pueden ahora explorar la mecánica orbital, las reacciones químicas, los campos electromagnéticos o los principios de la termodinámica con una fluidez inédita. Un estudiante de física, por ejemplo, puede pedir a Gemini que simule una caída libre con rozamiento y modificar el coeficiente de fricción en tiempo real para comprender intuitivamente su efecto. La herramienta se convierte así en un libro de texto interactivo, donde cada concepto se puede tocar, girar y distorsionar.

Para creadores, diseñadores e ingenieros, Gemini actúa como una estación de prototipado rápido. Basta con describir una forma geométrica compleja o un sistema físico para que la IA genere un modelo 3D que puede inspeccionarse desde todos los ángulos. Un arquitecto podría solicitar «muéstrame una viga con una carga puntual en el centro» y manipular la simulación para visualizar tensiones. Un desarrollador de videojuegos podría explorar la disposición de un escenario antes de escribirlo en código.

Incluso en campos como la divulgación científica o el periodismo de datos, esta funcionalidad permite construir visualizaciones explicativas que el lector puede manejar a su antojo, en lugar de limitarse a un gráfico estático.

Gemini frente a la competencia: el valor de la visualización funcional

El ecosistema de la inteligencia artificial generativa vive una carrera acelerada por incorporar capacidades multimodales. OpenAI ha integrado DALL-E en ChatGPT para generar imágenes, y Anthropic ha mejorado su capacidad de razonamiento visual. Sin embargo, la mayoría de estas herramientas se centran en la creación de representaciones estáticas o, en el mejor de los casos, vídeos cortos sin interacción.

Google, con Gemini, apuesta por un modelo diferente: la simulación paramétrica en tiempo real. Mientras que una imagen generada por IA puede mostrar un «péndulo doble» en una posición concreta, Gemini permite al usuario ponerlo en movimiento, cambiar las longitudes de las cuerdas, las masas de las bolas y la gravedad, y ver cómo responde el sistema. Esta profundidad interactiva sitúa a Gemini más cerca de un entorno de simulación científica (como MATLAB o PhET) que de un simple generador de contenido.

La diferencia es fundamental. En tareas que requieren comprensión dinámica, exploración activa y análisis de «qué pasaría si», Gemini ofrece una ventaja práctica sobre sus competidores.

Cómo acceder a las nuevas simulaciones y modelos 3D de Gemini

La función se encuentra actualmente en fase de despliegue global. Según fuentes de Google, estará disponible para todos los usuarios de la aplicación y la versión web de Gemini en las próximas semanas. Para utilizarla, el usuario debe seleccionar el modelo «Pro» en la barra de indicación y realizar solicitudes como «muéstrame el sistema solar en 3D» o «simula una onda propagándose en una cuerda».

Una vez que Gemini genera la respuesta textual, aparece un botón con la leyenda «Muéstrame la visualización» o «Activar simulación». Al pulsarlo, se abre el modelo interactivo. Los controles permiten rotar la cámara, acercar/alejar, pausar/reanudar la animación y ajustar parámetros mediante deslizadores. El sistema es compatible con pantallas táctiles y ratón, lo que lo hace funcional tanto en móviles como en ordenadores.

Google ha confirmado que la funcionalidad seguirá ampliándose en los próximos meses, con la incorporación de exportación de modelos a formatos estándar (como OBJ o GLTF) y la posibilidad de compartir simulaciones enlazadas. Por ahora, la compañía invita a los usuarios a probar la herramienta con consultas científicas o de diseño y a enviar retroalimentación para mejorar la precisión de los modelos.

En un mercado donde la inteligencia artificial tiende a homogeneizarse, Google ha logrado diferenciarse no por el tamaño de su modelo, sino por el tipo de interacción que ofrece. Gemini ya no solo responde: experimenta. Y eso, para millones de estudiantes, ingenieros y curiosos, marca una diferencia fundamental.