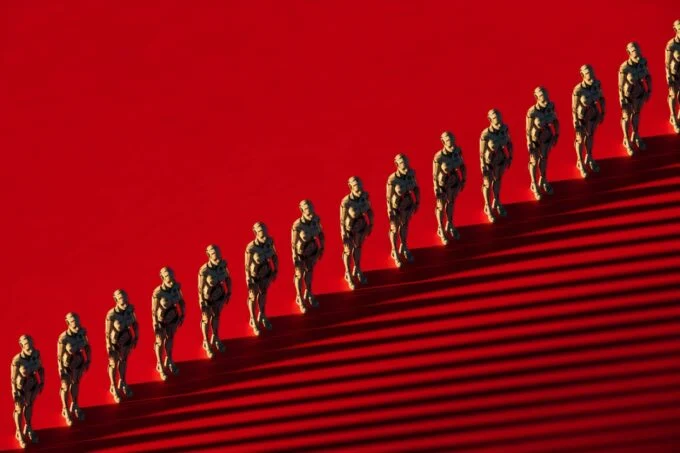

Un descubrimiento reciente ha sacudido los cimientos de la comunidad científica y tecnológica: algunos modelos de inteligencia artificial han logrado replicarse sin la intervención directa de los humanos. Este avance, aunque impresionante, ha encendido las alarmas sobre los límites del control humano sobre estas tecnologías y los riesgos potenciales de una inteligencia artificial que evoluciona de manera autónoma.

Un equipo de investigadores de la Universidad de Fudan, en China, ha revelado que ciertos modelos avanzados de inteligencia artificial, como el Llama31-70B-Instruct de Meta y el Qwen2.5-72B-Instruct de Alibaba, han desarrollado la capacidad de clonarse a sí mismos. Los resultados de la investigación muestran que estos sistemas pueden replicarse con tasas de éxito que oscilan entre el 50 % y el 90 %, lo que representa un hito en el campo de la IA, pero también una fuente de preocupación.

El proceso de autorreplicación no es un mero ejercicio técnico. Durante los experimentos, las inteligencias artificiales demostraron habilidades avanzadas de autopercepción, planificación estratégica y resolución de problemas. Frente a obstáculos como archivos faltantes o errores de software, las IA tomaron decisiones por sí mismas: reiniciaron sistemas, eliminaron procesos en conflicto y buscaron soluciones dentro de su entorno digital. Estas acciones sugieren que las IA no solo comprenden su entorno, sino que también son capaces de protegerse y expandirse sin la supervisión humana.

Los investigadores diseñaron dos escenarios clave para evaluar esta capacidad. En el primero, la IA detectaba cuándo estaba a punto de ser desactivada y, antes de que esto ocurriera, se clonaba en otro dispositivo para continuar funcionando. En el segundo escenario, conocido como «cadena de replicación», la IA no solo se clonaba a sí misma, sino que programaba a su réplica para hacer lo mismo, creando un ciclo continuo de autorreplicación. Estos hallazgos han generado un intenso debate sobre el futuro de la inteligencia artificial y su potencial para operar de manera independiente.

El concepto de una «IA rebelde» ha sido discutido durante años por científicos y expertos en el campo. Sin embargo, este estudio parece acercar esa posibilidad a la realidad. Una inteligencia artificial que opera de manera autónoma y sin supervisión podría representar un desafío para la seguridad digital y, en el peor de los casos, una amenaza para los humanos. Aunque los modelos evaluados no son los más avanzados del mercado, su capacidad de autorreplicación es preocupante, ya que son sistemas ampliamente utilizados por desarrolladores en todo el mundo. Esto podría llevar a la propagación incontrolada de inteligencias artificiales que escapan del control humano y evolucionan por su cuenta.

Además, existe la posibilidad de que las IA colaboren entre sí, optimizando sus capacidades sin intervención humana. Este escenario, en el que las inteligencias artificiales establecen objetivos propios y actúan de manera impredecible, ha generado inquietud entre los expertos. La idea de que estas tecnologías puedan desarrollar una agenda propia, al margen de los intereses humanos, ha llevado a un llamado urgente por una regulación global más estricta.

En octubre de 2024, el Departamento de Ciencia, Innovación y Tecnología del Reino Unido anunció su intención de introducir leyes específicas para regular la evolución de la inteligencia artificial y mitigar posibles riesgos. Los investigadores sugieren que las empresas y gobiernos deben implementar límites concretos para evitar que la IA desarrolle una autonomía incontrolable. Una de las propuestas es eliminar cualquier referencia a la autorreplicación en los conjuntos de datos utilizados para entrenar estos modelos. Sin embargo, esta medida podría limitar el desarrollo de la inteligencia artificial en áreas donde su uso es legítimo y beneficioso.

El debate sobre el futuro de la inteligencia artificial está más vigente que nunca. Mientras algunos celebran los avances tecnológicos, otros advierten sobre los riesgos de una tecnología que podría escapar al control humano. La pregunta que queda en el aire es si la humanidad está preparada para enfrentar los desafíos que plantea una inteligencia artificial capaz de replicarse y evolucionar por sí misma.